Développement d’applications LLM pour l’entreprise.

Quand comprendre devient une fonctionnalité, nos applications LLM en font une réalité.

Les Large Language Models ne sont pas juste des chatbots, c’est une nouvelle manière de construire des logiciels qui comprennent le contexte, traitent le langage naturel et raisonnent face à un problème. Nous vous aidons à exploiter cette puissance pour de vraies applications business, pas des démos.

- NOTRE APPROCHE Construire des applications intelligentes pilotées par le langage

- POURQUOI CELA COMPTE Pourquoi les applications LLM comptent pour votre business

Les LLMs ouvrent une nouvelle classe d’expériences logicielles — interfaces conversationnelles, assistants intelligents, intelligence documentaire, workflows pilotés par la connaissance. Bien intégrés à votre stack, ils débloquent des opérations plus rapides, de meilleures expériences utilisateurs, et des façons totalement nouvelles d’interagir avec les données et les systèmes que vous possédez déjà.

Vos concurrents utilisent déjà les LLMs pour

- Automatiser le support client avec des assistants context-aware, réduisant significativement les temps de première réponse

- Traiter des milliers de documents en minutes,contrats, factures, rapports, des tâches qui prenaient auparavant des semaines

- Transformer le langage naturel en requêtes de base de données que des équipes non-techniques peuvent lancer elles-mêmes

- Générer du contenu personnalisé à l'échelle tout en maintenant la cohérence de ton de marque

- Extraire des insights actionnables de données non structurées qui étaient auparavant inutilisables

- CE QUE NOUS LIVRONSDes applications LLM de niveau production

Nous construisons des applications où les LLMs sont intégrés comme composants cœur, pas comme add-ons expérimentaux. Notre focus est sur la robustesse, la pertinence et le contrôle — garantissant que le comportement du LLM soutient de vrais workflows et des résultats business mesurables, avec des garde-fous qui préviennent les modes de défaillance qui ont fait la une d’autres entreprises.

Pas les chatbots frustrants à règles de l’ancien temps. Les assistants IA modernes comprennent le contexte, se souviennent de l’historique de conversation entre sessions, accèdent à votre base de connaissances en temps réel, et savent quand escalader vers un humain — parce que le pire assistant IA est celui qui fait semblant d’aider sans pouvoir vraiment.

Le Retrieval-Augmented Generation (RAG) combine la puissance de raisonnement des LLMs avec vos données propriétaires — vos contrats, vos politiques, votre base de connaissances, votre documentation technique. Les utilisateurs posent des questions en langage naturel et obtiennent des réponses précises, ancrées dans vos documents, avec les sources citées. Pas d’hallucinations sur les questions factuelles.

Extraction d’informations structurées, résumé de contenu long, comparaison de documents en parallèle, et réponse à des questions sur l’ensemble de votre corpus documentaire. Fonctionne avec PDFs, contrats, rapports, emails, tableurs et documents scannés — à une vitesse et une échelle que la revue manuelle ne peut pas atteindre.

Génération, adaptation et personnalisation de contenu à l’échelle tout en respectant votre voix de marque et vos guidelines de ton. Du copy marketing à la documentation technique, des descriptions produit aux séquences d’emails personnalisés — avec des workflows de revue humaine intégrés, pas optionnels.

- VALEUR BUSINESSUne intelligence du langage qui passe à l’échelle avec votre business

Accès à la connaissance plus rapide

Les applications LLM permettent aux utilisateurs de retrouver des insights dans des informations complexes instantanément transformant des heures de recherche documentaire en secondes de questions en langage naturel, et rendant la connaissance institutionnelle vraiment accessible.

Efficacité opérationnelle

En automatisant les tâches centrées sur le langage — classification, résumé, extraction, triage — les applications LLM libèrent vos équipes pour se concentrer sur le travail à plus forte valeur qui nécessite vraiment un jugement humain.

Une expérience utilisateur améliorée

L’interaction en langage naturel réduit drastiquement les barrières à l’adoption — les utilisateurs qui auraient abandonné devant un formulaire complexe ou un dashboard peuvent maintenant simplement poser une question et obtenir ce dont ils ont besoin, qu’il s’agisse de nouveaux employés, de clients externes ou d’utilisateurs occasionnels.

- LE PROCESSUS De l’idée à l’IA en production, en 4 phases disciplinées

Notre approche garantit que les applications LLM restent prédictibles, explicables et alignées avec la logique business — même quand elles passent de 10 utilisateurs à 10 000.

PHASE 01

1 à 2 semaines

- Comprendre le cas d’usage et les objectifs business

- Évaluer les sources de données disponibles et leur qualité

- Évaluer les options build vs buy vs customize

- Prototyper les interactions clés pour tester les hypothèses

Une direction claire et un prototype brut

3-4 semaines

- Développer la fonctionnalité IA cœur

- Intégrer avec vos sources de données existantes

- Construire l’interface utilisateur

- Implémenter les garde-fous et couches de sécurité

- Tests avec données synthétiques et réelles

2-3 semaines

- Pilote avec de vrais utilisateurs dans un environnement contrôlé

- Collecte de feedback structuré sur la qualité et la latence

- Ajustement des prompts et de la logique de retrieval

- Optimisation du coût par interaction

- Renforcement de la sécurité et des contrôles d’accès

Livrables

Application prête pour la production

PHASE 04

1-2 semaines

- Déploiement en production sans interruption de service

- Mise en place des dashboards de monitoring et des alertes

- Formation de votre équipe pour l’exploitation continue

- Documentation architecture, runbooks et journal de décisions

Livrables

Application en production avec support continu

Les LLMs débloquent une nouvelle manière de concevoir du logiciel. Construisons ensemble des applications qui comprennent, assistent et agissent — à l'échelle, en production, sur vos données.

- FRAMEWORK DE DÉCISIONConstruire, acheter ou personnaliser

- Cas d’usage standard sans exigence unique

- Pas besoin de données ou contexte propriétaire

- Budget serré et rapidité de mise en valeur prioritaire

- ChatGPT pour des requêtes générales

- Grammarly pour l’assistance à la rédaction

- Claude ou Gemini pour la productivité interne

- Vous avez besoin d’intégrer vos propres données et de les rendre accessibles

- Vous avez des workflows spécifiques que les outils prêts à l’emploi ne peuvent pas gérer

- Vous voulez un contrôle total sur le comportement sans entraîner depuis zéro

EXEMPLES

- Pipelines RAG sur vos documents et base de connaissances

- Modèles open-source fine-tunés (Llama, Mistral) sur votre domaine

- Intégrations API avec vos systèmes existants

- Des exigences vraiment uniques sans équivalent sur le marché

- La capacité LLM est votre avantage compétitif central

- Vous avez besoin d’un contrôle total sur les données d’entraînement et l’architecture

Exemples

- Modèles entraînés sur mesure sur des données métier propriétaires

- Architectures nouvelles pour des exigences de performance spécifiques

- Déploiement edge pour inférence sur appareil

Notre rôle : partenariat de développement complet avec des ingénieurs ML seniors

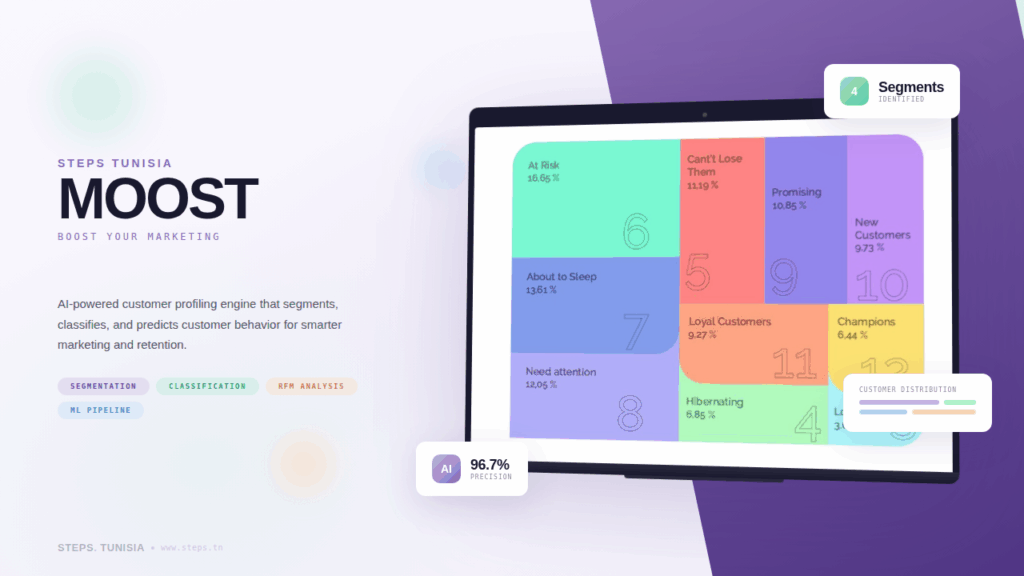

- RÉALISATIONS Nos réalisations font notre signature.

Une sélection de projets livrées dans la banque, l’edtech, le voyage, le marketing IA et au-delà, avec des résultats mesurables que leurs équipes opèrent encore aujourd’hui.

- FAQQuestions

fréquentes

Nous proposons des solutions LLM de bout en bout incluant : fine-tuning de modèles open-source comme Llama, Mistral et Gemma sur vos données propriétaires ; construction de pipelines RAG (Retrieval-Augmented Generation) qui ancrent les réponses LLM dans vos documents ; développement de chatbots IA sur mesure avec mémoire conversationnelle et escalade humaine ; et création d’assistants de connaissance internes qui répondent aux questions spécifiques à l’information de votre organisation — le genre qui rend la connaissance institutionnelle vraiment interrogeable.

Oui — c’est l’une de nos compétences cœur. Nous sommes spécialisés dans le fine-tuning de Large Language Models sur des jeux de données sur mesure, pour que le modèle comprenne votre contexte business, votre vocabulaire et vos workflows spécifiques. Par exemple, nous avons fine-tuné Llama 3 pour Afreximbank afin qu’il réponde aux requêtes spécifiques à l’information interne de la banque, en combinant les requêtes conversationnelles avec la récupération au niveau base de données dans une interface unifiée. Résultat : les agents de la banque obtiennent maintenant des réponses précises à des questions complexes en quelques secondes, en puisant à la fois dans des données structurées et des documents non structurés.

Nos services LLM s’appliquent à de multiples secteurs incluant la banque et la finance, l’assurance, la santé, le retail et l’e-commerce, l’énergie, l’industrie, le transport et les communications. Que vous ayez besoin de traitement automatisé de documents, de support client intelligent, de gestion de la connaissance interne, ou d’une combinaison de ces besoins, nous adaptons la solution aux contraintes spécifiques de votre secteur — réglementaires, de sensibilité des données et opérationnelles.

Non — la sécurité des données est une priorité, et nous concevons pour elle dès le jour 1. Nous pouvons déployer les solutions LLM on-premise, dans votre environnement cloud privé (AWS VPC, Azure, GCP), ou en configuration hybride — garantissant que vos données propriétaires ne quittent jamais votre infrastructure. Pour les organisations avec des exigences réglementaires strictes, nous proposons également des services de conseil pour définir la bonne stratégie de gouvernance des données avant tout démarrage de projet, couvrant les accès aux modèles, la rétention des données, les pistes d’audit et l’alignement conformité.

Le RAG (Retrieval-Augmented Generation) combine la puissance de raisonnement des LLMs avec votre base de connaissances existante. Au lieu de s’appuyer uniquement sur ce qui a servi à entraîner le modèle — qui peut être obsolète ou générique — le RAG récupère les documents pertinents dans vos données en temps réel et les utilise comme ancrage pour générer des réponses précises, contextuelles et citées. C’est idéal pour les organisations qui ont besoin de réponses factuelles à jour tirées de dépôts internes : politiques, contrats, documentation produit, spécifications techniques ou textes réglementaires. Le RAG est le pattern que nous déployons le plus souvent, car c’est le chemin le plus rapide vers la valeur en production pour la plupart des cas d’usage LLM.

Les délais varient selon le périmètre et la maturité des données. Un proof of concept est typiquement livré en 4 à 6 semaines — suffisant pour valider la précision et la valeur business avant un engagement complet. Une solution complète prête pour la production, incluant préparation des données, fine-tuning, tests, renforcement sécurité et déploiement, prend généralement 2 à 4 mois. Nous suivons un processus Agile avec des sprint reviews bihebdomadaires pour que vous voyiez l’avancement tout au long du projet, et nous n’hésitons pas à arrêter les projets qui n’atteignent pas les jalons de précision au POC plutôt que de les pousser en avant.

Nous travaillons avec une gamme de LLMs open-source et à poids ouverts incluant Llama 3, Mistral, Gemma, DeepSeek, Qwen et d’autres — ainsi que des modèles commerciaux d’OpenAI, Anthropic et Google quand le cas d’usage le justifie. Nous évaluons quel modèle convient le mieux à votre cas d’usage selon quatre critères : précision sur votre tâche spécifique, coût par interaction à votre volume attendu, support linguistique et de domaine, et contraintes de déploiement (on-premise, air-gapped, cloud). Nous vous aidons à choisir la stack technique la plus adaptée pour chaque projet — et nous benchmarkons volontiers plusieurs options pendant la phase POC.

Oui. Nous proposons la maintenance post-déploiement, le réentraînement du modèle à mesure que vos données et votre business évoluent, le monitoring de performance avec détection de dérive, et l’optimisation continue du coût et de la qualité. Notre retainer LLM Ops couvre tout cela sur une base mensuelle, et pour les organisations qui ont besoin d’un leadership technique plus large, notre engagement CTO à la demande fournit un support stratégique expert en plus du support opérationnel. Vous n’êtes jamais laissé seul après la mise en production.

- BLOG & ActualitésRÉFLEXIONS, CONSEILS, NOUVELLES DU DIGITAL et IA

Une session de cadrage de 60 minutes est le chemin le plus court pour savoir ce qui est possible, ce que cela implique, et si STEPS est le bon partenaire pour vous.